-

手机端大模型推理引擎PowerInfer-2.0解决内存与算力挑战

了解手机端大模型推理引擎PowerInfer-2.0如何解决内存不足与算力不足的挑战,实现在智能手机上快速推理,保障AI模型性能与隐私安全。- 787

- 0

-

阿里云通义千问GPT-4级主力模型Qwen-Long降价至0.0005元/千tokens

阿里云通义千问推出GPT-4级主力模型Qwen-Long,API输入价格降至0.0005元/千tokens,降幅达97%。该模型性能对标GPT-4,价格远低于其他厂商模型,将加速AI应用的爆发。这里介绍了Qwen-Long的性能优势、阿里云的推理成本和性能优势,以及云上多模型调用和数据安全保障的优势。- 889

- 0

-

大模型推理部署框架设计 – DB-GPT多模型架构解读与未来规划

本文介绍了DB-GPT多模型推理部署框架的设计目标、架构解读、多模型部署、运维与可观测性以及未来规划,为AIGC应用探索和生产落地提供了思路与解决方案。- 0

- 0

-

新技术代码链(CoC)提升大模型推理能力

最新技术代码链(CoC)结合编码逻辑与自然语言理解,提升了大模型基于代码的推理能力,对机器学习和人工智能领域具有重要意义。论文详细介绍了CoC的原理和优势,以及与其他推理方法的比较。- 829

- 0

-

PyTorch团队开发GPT-fast,大模型推理速度提升10倍的方法揭秘

了解PyTorch团队如何通过GPT-fast项目将大模型推理速度提升10倍,涉及GPU量化和推测性解码等方法,助力大型语言模型更高效运算。- 541

- 0

-

昇腾CANN 7.0 黑科技:大模型推理部署技术解密

本文解密了昇腾CANN 7.0黑科技,介绍了大模型推理部署技术,包括自动并行切分、KV Cache机制、量化技术和FlashAttention融合算子的优化,旨在提升AI基础设施的推理性能。- 738

- 0

-

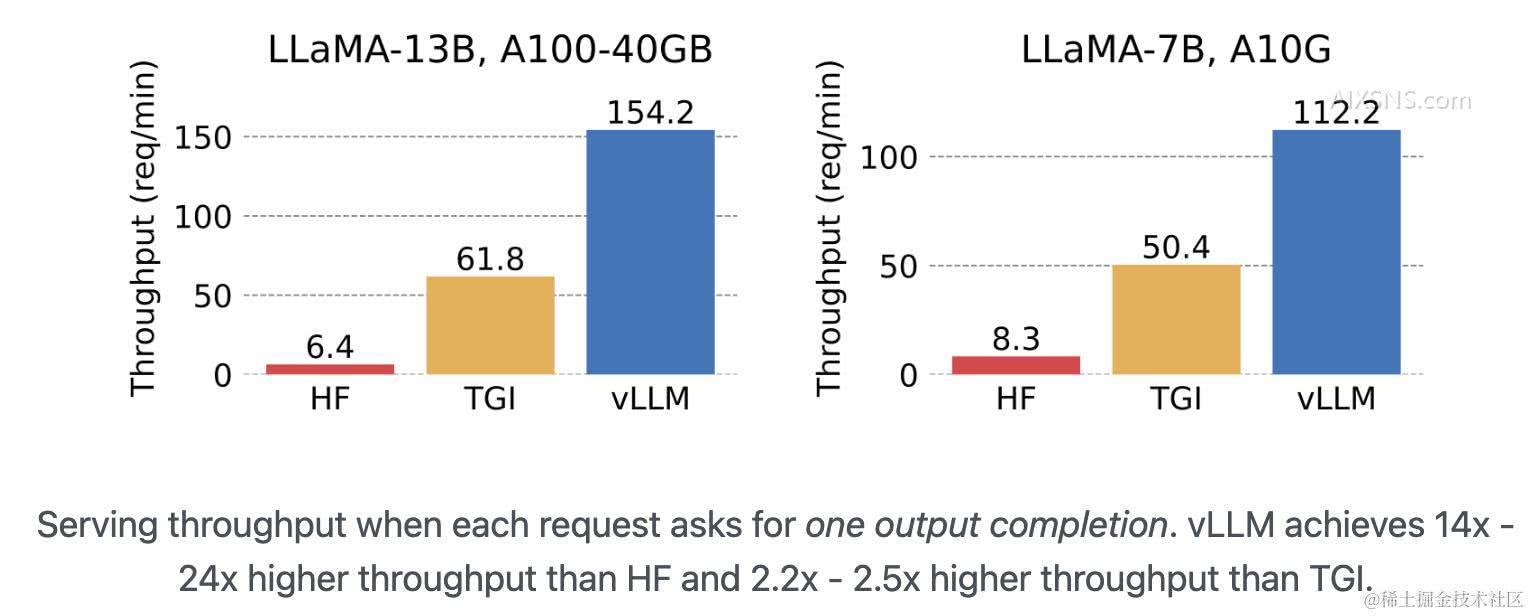

大模型推理框架概述:vLLM、HuggingFace TGI 和 FasterTransformer

本文概述了业界知名的大模型推理框架 vLLM、HuggingFace TGI 和 FasterTransformer,分析了它们的主要特性和性能对比,适用场景和存在的问题。- 58

- 0

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!